dsgeНазывайте это как привыкли, я пойму, тут вообще речь не о том, а как оценивать дисперсию при известном матожидании. Оценка дисперсии, посчитанная традиционным образом, будет, как правило, велика.

Да, некоторые называют выбросами только "мусорные данные".

Сарказм понятен, но англовики не дураками пишется и модерируется, для справки вполне сойдет.

Не устраивает - вот классика. Это не устраивает - несите свое, более авторитетное. Хотя я при этом ничего нового не узнаю, что есть авторы, которые слово "выброс" используют в другом смысле, мне известно. Но есть и другие. Вопрос договоренностей и терминологии, повторюсь.

Цитата:

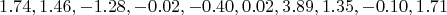

[...] above we remarked on the way in which outliers may influence the propriety of different methods of estimating parameters in the basic model. Let us consider a more specific example. Suppose the following random observations were obtained for some variable of interest:

We wish to estimate the ‘centre’ of the parent population. Initial considerations suggest that the population may be normal,

, so the sample mean would clearly be a sensible form of estimator. But the value

makes us suspicious of the

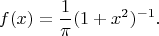

assumption! In fact, these data were generated as a random sample from a Cauchy distribution, with probability density function

The sample mean here is not even consistent, let alone of reasonable efficiency, and we should have made very poor use of our data in the estimation procedure had we used it as an estimator of location.

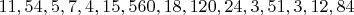

Observations far removed from the main body of the sample arise naturally in sampling from a Cauchy distribution, and this contrasts with the common situation where the presence of an outlier suggests the possible inappropriateness of a model. A similar phenomenon occurs not infrequently in biological contexts. For example, the distribution of the number of cones on a fir tree for trees in a given area of forest, or the distribution of the number of lepidoptera of the same species present and observed in a particular location, are both characterized by high skewness. A typical sample from this latter type of distribution is given below; it refers to the number of individuals of a given species in a random sample of nocturnal Macrolepidoptera caught in a light-trap at Rothamsted (Fisher, Corbet and Williams, 1943):

Here

we have a situation in which an outlying value (the value 560) is an inherent feature of the natural data pattern, and in no way anomalous.

"Outliers in Statistical Data" by Vic Barnett and Toby Lewis

В общем-то, подход довольно понятный - не всегда ясен заранее даже вид распределения, и что-либо отсеивать, не зная природы отклонений, преждевременно. Возможно, мы при этом утратим как раз наиболее существенную информацию. А не зная этой информации, называть сильно отклоняющиеся от основной массы наблюдений значения "выбросами" в том смысле, который подразумеваете вы, и работать с ними соответственно, несколько опрометчиво. Но имеете право.

Может, хватит уже об этом? Замените слова на те, которые вам нравятся, суть у поста, к которому вы острый неприязнь испытываете, не поменяется :) А с меня не убудет. Мне неинтересен этот спор, за его бессмысленностью. Это терминологические вопросы, о них можно всегда спорить до одури, переливая из пустого в порожнее.