--mS-- писал(а):

Эк тщательно Вы скрываете, что именно хотите получить

Совсем нет, отнюдь. Просто для этого форума задача может показаться слишком детской, да и латех для меня сложен -- все никак не перейду на него с OpenOffice.

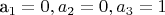

Вот в чем задача. Имеем

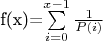

(*)

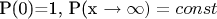

где x - натуральное число. f(x) для определенности считаем также натуральным числом, a - случайные величины, принимающие значения 0 и 1, причем известна вероятность 1 -- она зависит от x(i). Т.е. ведет себя эта конструкция так: x(i=0) = 0, вероятность того, что

равна

. Например, получается так:

. В этот момент сумма (*) становится равна 1 и, соответственно, вероятность P того, что

становится равной P(1), и так далее.

Требуется найти f(x), учитывая, что x и f(x) стремятся к бесконечности.

Получается так:

Фурмулу для вероятности не привожу, ибо она мудреная немного.

P меняется монотонно.