Евгений Машеров, задача в постановке выше прикладной не является, но она приближается к некоторой интересной для меня прикладной задаче. МНК как грубое начальное приближение, разумеется, стоит использовать, тем более, что прикладная задача нелинейная. Проблема в том, что в прикладной задаче дискреты находятся не в целых числах, а чуть-чуть смещены туда-сюда. И прикладная задача состоит в том, чтобы оценить все эти смещения (и дать оценку погрешностей этих оценок) для диапазона значений дискретов от 0 до, скажем,

N. И тут без честной статистики уже никак, по-моему.

Стоит ли усложнение возможного улучшения - не уверен.

Как самостоятельная задача, на мой взгляд, она очень даже интересна. Кстати, мой подход трактовать функцию максимального правдоподобия как функцию плотности вероятности (после нормировки) обнаружить параметры модели такими-то — это, вообще, грамотный подход? Или есть что-то более логичное/удобное/теоретически обоснованное?

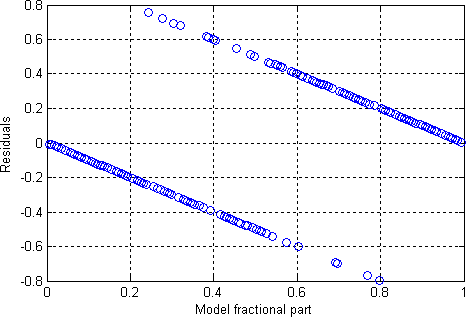

-- 28.10.2022, 18:53 --Поигрался тут с МНК для данных на предыдущей картинке. Забавная ситуация получается с отклонениями экспериментальных данных от модели:

Они сильно коррелируют с дробной частью модели. В любом другом случае, при наличии такой явной корреляции с какой-либо функцией от исходных данных (например,

параболическая зависимость от иксов), можно было бы утверждать, что модель неверна. Здесь же модель верна, вот только с обсчётом, видимо, что-то не то.